Information and Intelligence

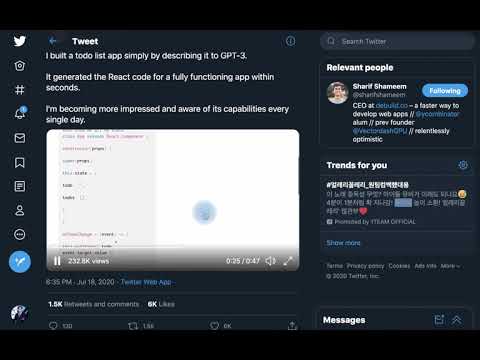

최근 인공지능 커뮤니티의 최대 화제는 GPT-3라는 OpenAI의 기술입니다. 심지어 일반인들도 GPT-3를 이야기하고 있는데, 도대체 이 기술이 어떤 인공지능 기술이길래 이렇게 난리가 난 것일까요? 간략한 기술의 소개와 왜들 그렇게 이 기술에 대해 많은 이야기를 하는 것인지 알아보도록 하겠습니다.

오늘 리뷰에 등장하는 Jay Alamar의 사이트 URL은 아래를 참고하시면 됩니다.

http://jalammar.github.io/how-gpt3-works-visualizations-animations/